文 | 酷乐志

北京环球度假区春日狂欢主题活动于3月21日正式开启。去年首个“可加入”的春日狂欢派对全面升级回归,今年将有国际知名舞团MALEVO加盟。首个北京环球影城 · 原神互动主题餐厅-颂花盈皎宴也在3月21日首次开放,以主题公园的独有方式呈现以IP为核心的线下场景和娱乐体验,进一步满足年轻群体的多元娱乐需求。此次春日狂欢活动将持续到6月1日。

今年春日狂欢派对升级归来,其中穿靴子的猫和软爪吉蒂,阿历克斯、朱利安国王、歌莉娅,以及小黄人凯文、鲍勃和斯图尔特在内等十余位北京环球度假区明星角色,和数位身着多彩华服的舞者一起带来极具感染力的狂欢派对。世界顶尖舞团MALEVO也将来到狂欢舞台带来歌舞表演,呈现的专属演出体验,其中融合打击乐、踢踏舞、鞭舞,带领现场游客尽情起舞,释放高能情绪。今年,仍延续春日狂欢派对强互动与“人人可参与”的特点,鼓励游客亲身参与其中,共同完成舞台精彩。

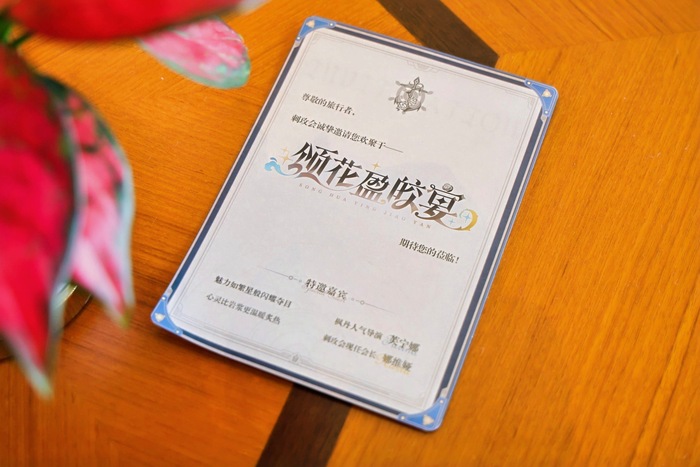

春日狂欢中最值得期待的要数北京环球度假区与中国游戏IP原神合作首度推出互动主题餐厅——颂花盈皎宴,以主题公园的方式,呈现了以原神IP为核心,独一无二的线下场景和娱乐体验。北京环球度假区与原神团队共同创作了基于游戏中枫丹国度及其角色为背景的原创故事。

近两个小时的互动体验中,融合了包括用餐、见面会、演出和互动游戏等多种形式,将线上的游戏世界延伸至线下五感全开的多重感官沉浸式体验,并为粉丝提供了交流互动、表达自我的空间。

来到现场参与体验的《原神》忠粉也表示:“现场主要角色声线还原太到位了,演员们的临场互动和生动表演也给人留下了深刻印象,游戏粉丝耳熟能详的《轻涟》的现场演绎更是令人惊喜。“这次创新尝试,也是北京环球度假区持续探索将本土IP故事和潮流娱乐引入季节性活动中,为游客提供全新的娱乐体验。

有话要说...